基于这个思想,在深度学习中,我们常常使用剪枝、量化、蒸漏等模型压缩手段来压缩模型,以达到模型性能与模型复杂度之间的平衡。 联邦学习在训练的过程中,影响其训练效率的一大因素就是服务端与客户端之间的模型...

”深度学习 联邦学习 模型压缩 隐私计算“ 的搜索结果

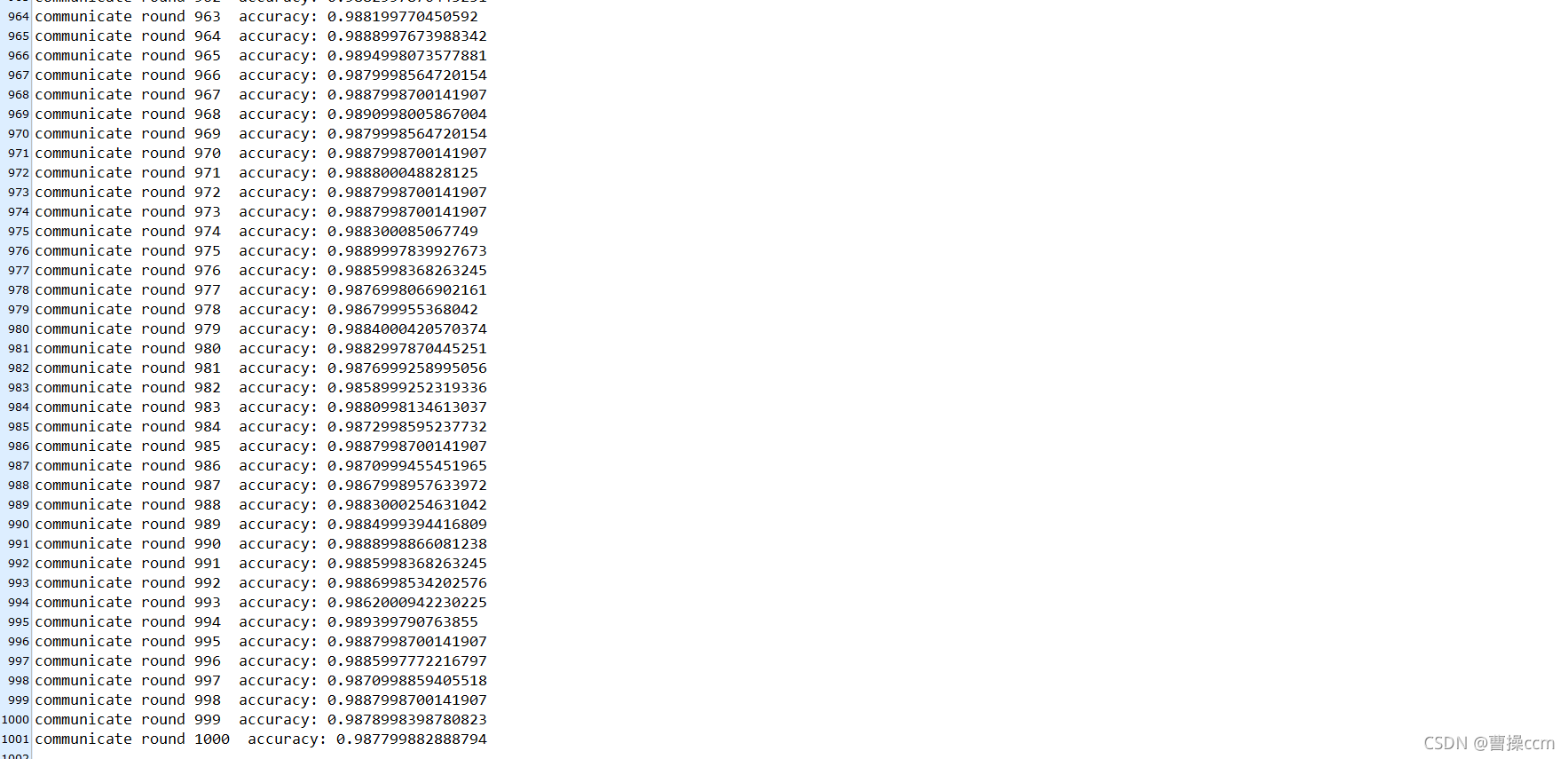

稀疏化策略本质上模型压缩的一种,同样是通过传输少量的参数,一方面减少服务端与客户端之间的网络带宽;另一方面也能够防止全局模型参数泄露。 稀疏化是指,在本地联邦训练的过程中,每一个客户端中保存一份掩码...

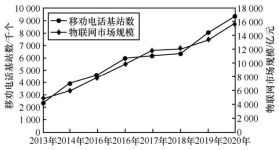

第28篇联邦学习:保护隐私的分布式学习 1.背景介绍 1.1 数据隐私保护的重要性 在当今的数字时代,数据被视为新的"石油",是推动人工智能和机器学习算法发展的关键燃料。然而,随着数据收集和利用的增加,个人...

d巴基斯坦费萨拉巴德38000农业大学数学与统计系阿提奇莱因福奥文章历史记录:收到2022年2022年11月6日修订2022年11月29日接受2022年12月8日网上发售保留字:差分隐私块坐标下降深度学习模型隐私会计A B S T R A C T...

本文章主要参考第32届国际人工智能联合会议(IJCAI)上由清华大学人工智能研究院知识工程研究中心(KEG)、北京智谱华章科技有限公司、开放群岛开源社区联合编写的《2023联邦学习全球研究与应用趋势报告》,对重点...

近年来,大规模预训练语言模型(Large Language Models, LLMs)取得了令人瞩目的成就,在自然语言处理(NLP)领域掀起...然而,训练这些大型语言模型需要消耗大量的计算资源和训练数据,这给模型的部署和应用带来了不小的挑战。

联邦学习算法总结,从不同的角度对联邦学习方法进行分类。

边缘计算与深度学习综述摘要背景,度量与框架深度学习的背景深度学习性能的度量DNN推理和训练的可用框架深度学习在边缘侧的应用计算机视觉自然语言处理网络功能IOT虚拟现实和增强现实(VR and AR)边缘侧的快速推理...

10122局部正则化和稀疏化的差分私有联邦学习中国科学院自动化研究所中国科学2中国科学院大学人工智能学院[email protected]张曦@ gmail....隐私(DP)为联邦学习中特定于任何用户数据的信息提供可认证的隐私保证...

1. 背景介绍 随着互联网的飞速发展,信息过载问题日益严重,用户难以从海量信息中找到自己真正感兴趣的内容。推荐系统应运而生,旨在解决信息过载问题,为用户提供个性...近年来,深度学习技术在图像识别、自然语言处理

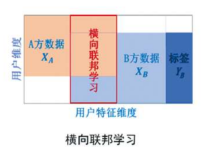

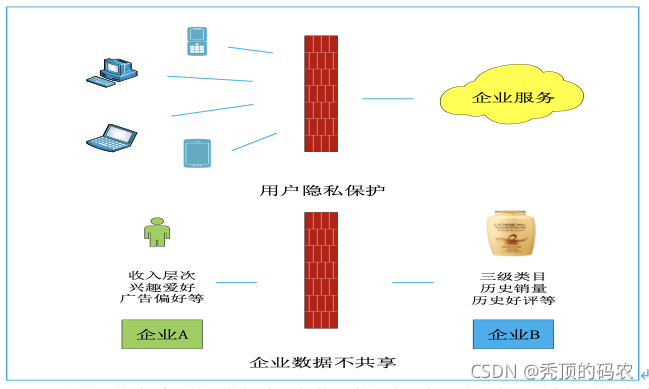

“联邦学习” 实际上是一种加密的分布式机器学习技术,参与各方可以在不披露底层数据和底层数据的加密(混淆)形态的前提下共建模型。 如果机构之间的数据无法互通,一家企业一家机构数据量有限,或者是少数巨头公司...

联邦学习是一种以分布式方式训练模型的机器学习技术,其主要思想是确保参与方的数据保留在本地,而将训练的模型进一步上传和聚合到服务器。后续学习过程仅使用模型进行训练,保护了参与方的数据隐私,从而保护了数据...

推荐文章

- 【超详解】Python中getattr和getattribute是如何调用的?_python getattribute-程序员宅基地

- 修复所有 bug 并不能解决所有问题

- Hive数据查询(基本查询、RLIKE正则匹配、union联合、Sampling采样、Virtual Columns 虚拟列)_hive rlike-程序员宅基地

- STM32——.bss .data .text 与Code, RO-data , RW-data, ZI-data的关系-程序员宅基地

- liveGBS的使用_livegbs对接 csdn-程序员宅基地

- NDK 编译(二)—— NDK 编译与集成 FFmpeg

- 12.6.1 实验5:IOS恢复

- GSV6712-程序员宅基地

- 二,网络安全常用术语

- 一文搞懂 JVM 架构和运行时数据区 (内存区域)-程序员宅基地